AI時代の民主主義(ChatGTP)

AI時代の民主主義――「劇場」を管理するのか、「熟議」を回復するのか

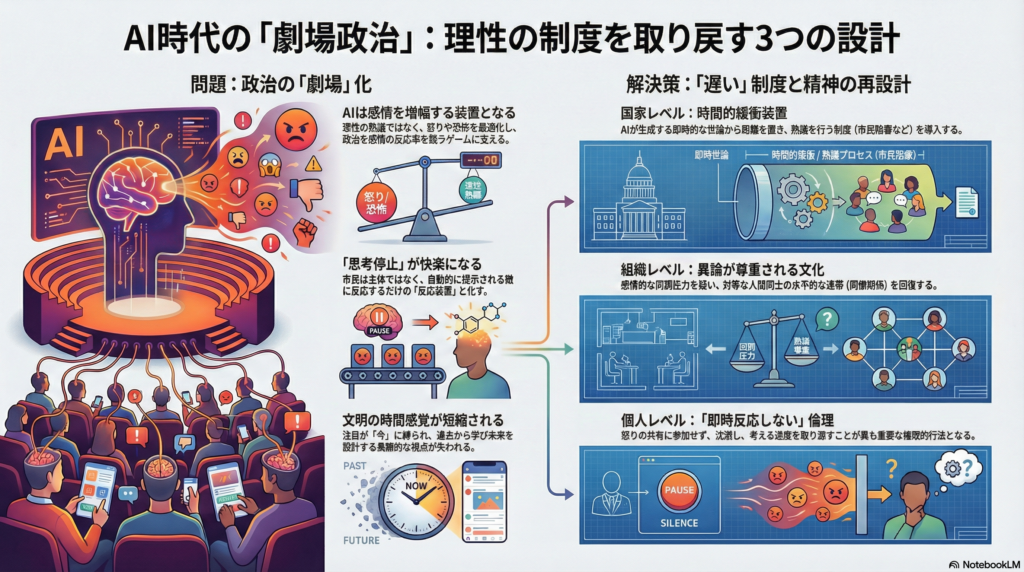

AI時代の政治的課題は、もはや「独裁か民主主義か」という古典的対立ではない。問われているのは、民主主義そのものが劇場化に耐えられる設計になっているかという、より根源的な問題である。

民主主義は本来、理性的熟議を通じて集団意思を形成する制度である。しかしAIによって可視化・最適化されたのは熟議ではなく、感情反応であった。アルゴリズムは投票の質を高めるのではなく、怒り・恐怖・分断を効率よく循環させることで、民主主義を「参加型エンタメ」へと変質させている。

このときAI倫理は、しばしば誤った問いから始まる。「AIは中立か」「偏っていないか」という技術論に終始し、人間側の政治的欲望を問わない。だが実際には、AIは価値を創造しているのではなく、人間社会に埋め込まれた欲望の勾配を忠実に増幅しているにすぎない。倫理的問題の核心は、AIよりも民主主義の側にある。

ハンナ・アーレントが警告したのは、暴力よりも「思考停止」であった。AI時代の劇場政治は、この思考停止を快楽として提供する。自分で考えなくても、怒るべき対象と正義の位置が自動的に提示される。ここでは、市民は主体ではなく、反応装置となる。

民主主義が崩れるのは、独裁者が登場したときではない。市民が熟議の重さを放棄したときである。AIはこの放棄を加速させるが、原因ではない。したがって、AI倫理を「制御の問題」としてのみ捉える限り、民主主義の劣化は止まらない。

必要なのは、民主主義の再設計である。第一に、AIが生成する即時的世論から距離を置く「時間的緩衝装置」を制度として組み込むこと。ランダム抽出型熟議、市民陪審、段階的意思決定などは、技術的にはすでに可能である。

第二に、透明性とは「アルゴリズムの公開」だけでは足りない。重要なのは、どの感情が政治的に報酬化されているのかを市民自身が理解できる構造である。倫理とは規制ではなく、理解可能性の回復にある。

第三に、個人レベルの倫理が決定的に重要になる。AI時代の民主主義において、最も倫理的な行為は「即時反応しないこと」である。共有しない、怒りに参加しない、沈黙の時間を取る――それらは消極的行為に見えて、実は制度を支える積極的倫理である。

AIは民主主義を破壊する運命にはない。しかし、民主主義が自らを更新できなければ、AIはその老化を容赦なく可視化するだろう。

劇場政治に対抗する倫理とは、英雄的抵抗ではない。考える速度を取り戻すこと、同僚として熟議に耐えること――それこそが、AI時代における民主主義の最低条件なのである。